专属客服号

微信订阅号

剖析产业发展现状

为区域/园区工作者洞悉行业发展

存储芯片的寒冬还在持续。根据Trend Force数据,DRAM内存市场已经连续三个季度走低,跌幅达15%~20%。

降价成为厂商保量为数不多的手段。以DRAM 上一季度指标性产品DDR4 8GB为例,批发价为每个1.48美元左右,环比下跌1%;4GB产品价格为每个1.1美元左右,环比下跌8%。然而,在DRAM整体低迷时,DRAM大军当中的一员HBM(High BandwidthMemory,高带宽存储器)却冒出了头。2023年后,三星和SK海力士的HBM订单快速增加,HBM3规格的DRAM价格上涨5倍。HBM正在掀起存储厂商的新一轮角力。

HBM浮出水面

HBM能在DRAM中逆势而上,很大程度也是乘了生成式人工智能的东风。众所周知,与生成式AI紧密挂钩的指标是算力。英伟达、AMD等厂商的GPU为AI模型训练和推理提供强大算力支撑。但在算力之外,带宽也成为提升数据计算效率的重要保障。带宽直接影响数据吞吐量,数据吞吐量越大,模型在单位时间内能够处理的数据便越多,响应越快。对于AI加速器而言,如果仅提升算力而在带宽上没有相应提升,就容易造成数据堆积,无法达到理想的数据处理速度。存储与计算之间紧密配合,才能够实现AI计算的效率提升。

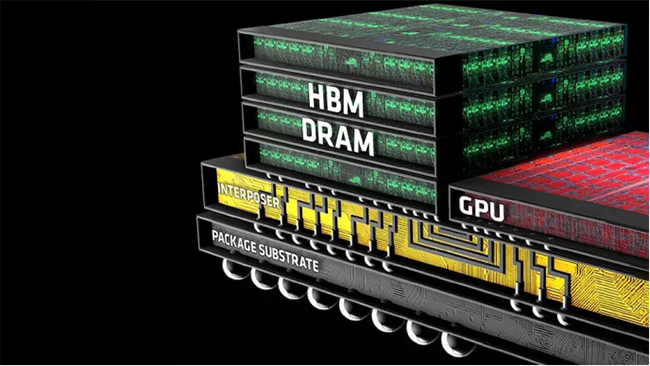

IEEE电子器件与集成电路深圳分会首任主席、安徽工程大学副教授林信南向《中国电子报》记者表示:“作为DRAM家族中的一员,HBM具有高带宽,并同GPU一起封装,从而在实现更高传输速率的同时,具有更好的能耗比。”

多层堆叠的HBM

虽然DRAM的带宽可满足用户在消费级显卡当中的基础存储需求,但是并不能满足企业对于商业级存储和计算的期待。当前市面上的AI加速器几乎都配置了不同型号的HBM。英伟达的A100及H100,各搭载80GB的HBM2E及HBM3,在其Grace Hopper芯片中,单颗芯片HBM搭载容量达96GB。AMD的MI300搭载HBM3,谷歌也传出其TPU会搭载HBM。

如果说HBM是DRAM寒冬中的逆行者,那么HBM3便是HBM当中的“尖子生”。在技术不断升级的过程中,从HBM2至HBM3的性能也得到了更大幅度的提升。JEDEC在于2022年发布的HBM3高带宽内存标准中提到,HBM3可提高应用程序中数据的处理速率。在图形处理、服务器以及高性能计算(HPC)等应用程序中,更高的带宽和更低的功耗对于提升解决方案的市场接受度至关重要。英伟达技术市场总监Barry Wagner表示:“HBM3凭借其更强和更可靠的性能,能够更好地支持需要巨大内存带宽和容量的应用程序。”

在与DRAM家族DDR、GDDR等品类的横向竞争当中,HBM凭借超高带宽更能适应HPC的计算需求,同时,HBM也是配合高算力GPU提升计算效率必不可少的一环。

新一轮存储竞赛拉开序幕

在摩尔定律脚步放缓的今天,算力提升的成本和难度持续攀升,各大厂商瞄准了还有更大提升空间的HBM,特别是HBM3,以此开展新一轮的存储竞赛。根据Trend Force预测,2023年HBM需求量将年增58%,2024年将持续增长30%以上。到2025年,HBM整体市场有望达到20亿美元以上,2026年预期达到57亿美元。

当前,英伟达的H100和AMD的Instinct MI300均使用SK海力士的HBM3,并且未来两家厂商各自发布的H200和Instinct MI300X也都会考虑使用性能更好的HBM3E。

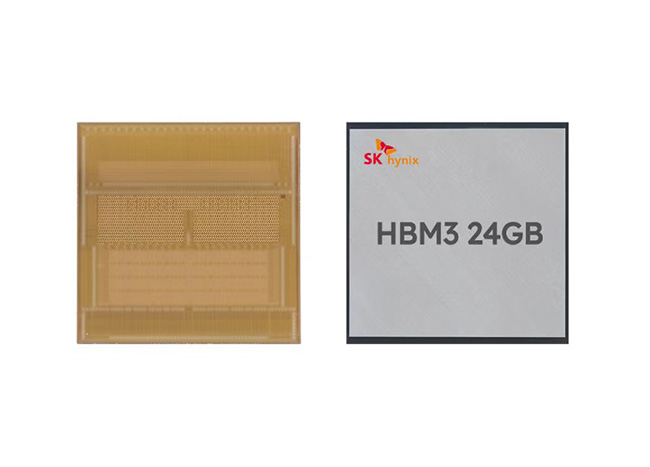

由于HBM3需求暴增,SK海力士已决定在2024年进行扩产。海力士于4月20日宣布率先开发出12层HBM3产品,单颗内存高达24GB,在内存比16GB产品提高50%的同时,还能保持堆叠厚度与后者相同。5月30日,海力士已经完成第五代10nm制程技术(1bnm制程)的开发。SK海力士DRAM研发主管Jonghwan Kim表示:“1bnm工艺会被应用于更广泛的产品中,例如在2024年上半年将推出的LPDDR5T和HBM3E当中。”根据公开信息,HBM3E的数据处理速度为8Gbps,相比HBM3提升了25%。

SK海力士的24GB HBM3 (图片来源:SK海力士)

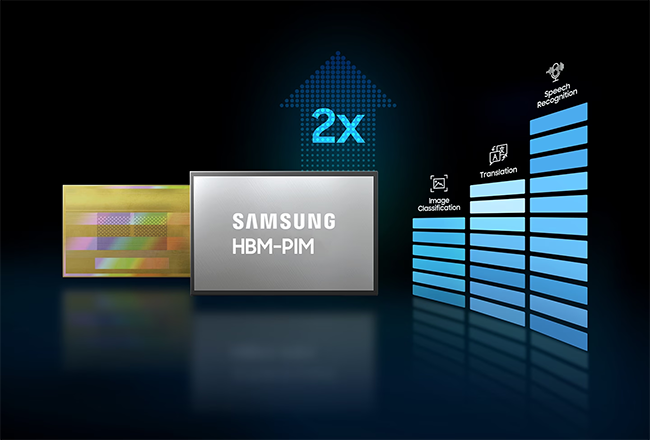

在DRAM上选择减产断供的三星也将重点关注HBM。“我们充分认识到人工智能、图形处理和机器学习的快速增长正在推动HBM3这些关键产品,HBM3不仅在性能方面表现出色,而且还提供了前所未有的能效。”三星集团副总裁Kyung-SooHa说。4月26日,三星向KIPO韩国知识产权局提交了一款名为“Snowbolt”的商标,其申请书写道:“一款用于高性能计算、人工智能和超级计算机计算的动态和高带宽存储器。”从命名风格来看,它将是三星HBM3产品Icebolt的下一代存储器。除此之外,三星也提出了“内存内处理技术”,即将存算一体化(PIM)集成到HBM中,以更好地满足人工智能需求。HBM-PIM的组合模式也可能成为三星在存储市场竞争中的另一个杀手锏。

三星的内存内处理技术HBM-PIM (图片来源:三星)

目前,HBM市场基本是SK海力士、三星和美光“三分天下”。数据显示,至去年年底,三家各自占有50%、40%和10%。面对占比之和近90%的两家企业,美光在HBM上的行动起步较晚。2020年美光正式推出HBM2用于高性能计算,并于近期在财报中表示:“HBM3将在2024 财年贡献有意义的收入。”

成本和工艺仍是痛点

HBM3看似火爆,但也不得不考虑成本和工艺问题。“由于HBM采用复杂的TSV封装工艺,其生产良率较低,产品开发周期较长,生产成本也较高。复杂的封装工艺和较高的成本限制了HBM的渗透和快速增长。”半导体行业专家张先扬告诉《中国电子报》记者。

同时,HBM的发展也遵守从“高带宽”向“更高带宽”的迭代逻辑。霍夫曼公关内容营销经理张亚表示:“HBM原本就属于高带宽,如果要在此基础上更进一步,那么可能需要使用另外的技术路径,比如WoW(晶圆对晶圆封装)。”

HBM的应用场景也有待拓展。HBM的高带宽小体积是优点,但是其堆叠工艺导致它缺乏灵活性,难以扩容且访问延迟高。长短板都十分明显的HBM应用场景变得十分聚焦。“HBM的市场定位主要应用于大存储容量、低功耗和高传输速率的领域,目前主要应用于AI和高密度计算数据中心领域,但是未来像自动驾驶和移动式AR设备也有类似的需求。”张先扬说。

在自动驾驶方面,智能汽车和车路协同场景都涉及大量的数据传输,HBM的带宽优势能够发挥作用。但是由于成本问题,HBM3距离“上车”还有些时日。在头显设备方面,VR和AR系统需要高分辨率的显示器,这些显示器需要更大的带宽来实现处理器和内存之间的数据传输。苹果最新推出的头显设备Vision Pro也传出内置了SK海力士专门设计的高带宽DRAM来提升图像数据的处理效率。

高带宽DRAM和RI芯片是头显的重要部件 (图片来源:苹果官网)

“目前来说,CPU+DRAM技术较为成熟,成本相对较低,在多数‘对性能没有极端需求’的场合具有更好的性价比。而GPU+HBM的组合则更多用于对算力要求特别高的应用领域。从2D走向3D,集成度更高、能耗效率更高的HBM是未来趋势,随着TSV工艺和HBM设计的不断成熟,HBM自身的性价比也会有所提升,并将逐渐占据更多的市场。”林信南说。

作者:张心怡 王信豪 来源:中国电子报、电子信息产业网

本文为本网转载,出于传递更多信息之目的,并不意味着赞同其观点或证实其内容的真实性,如涉及侵权,请权利人与本站联系,本站经核实后予以修改或删除。

请完善以下信息,我们的顾问会在1个工作日内与您联系,为您安排产品定制服务

评论